Нейросети

Нейронные сети – это не просто модное слово в мире искусственного интеллекта, а настоящая революция в области машинного обучения. Давайте разберемся, что же это такое, как они работают и почему меняют мир вокруг нас.

Нейронные сети – это не просто модное слово в мире искусственного интеллекта, а настоящая революция в области машинного обучения. Давайте разберемся, что же это такое, как они работают и почему меняют мир вокруг нас.

Вдохновленные природой:

В основе нейронных сетей лежит идея, подсмотренная у природы – устройство нервной системы человека.

Мозг человека состоит из миллиардов нейронов, соединенных между собой триллионами синапсов. Эти соединения позволяют нам обучаться, запоминать информацию, принимать решения и реагировать на окружающий мир.

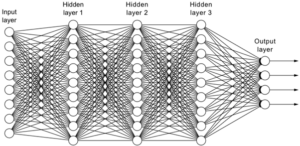

Нейронные сети – это искусственная имитация этой сложной системы. Они состоят из искусственных нейронов, соединенных между собой виртуальными синапсами.

Как они работают:

Каждый искусственный нейрон – это математическая функция, которая принимает входные данные, обрабатывает их и выдает выходные данные.

Сила нейронных сетей заключается в их способности обучаться.

Изначально связи между нейронами имеют случайные веса.

В процессе обучения сети на большом массиве данных, эти веса корректируются таким образом, чтобы сеть как можно лучше предсказывала или распознавала нужные паттерны.

Виды нейронных сетей:

Существует множество различных типов нейронных сетей, каждый из которых предназначен для решения определенных задач.

Наиболее распространенные:

- Сверточные нейронные сети: отлично подходят для обработки изображений и видео.

- Рекуррентные нейронные сети: используются для обработки последовательных данных, таких как текст или речь.

- Сети прямого распространения: применяются для решения широкого спектра задач, от классификации до прогнозирования.

Применение нейронных сетей:

Нейронные сети уже сейчас используются во многих сферах нашей жизни:

- Распознавание образов: от распознавания лиц на фотографиях до автономного вождения автомобилей.

- Обработка естественного языка: от машинного перевода до создания чат-ботов.

- Анализ данных: от прогнозирования финансовых рынков до выявления мошенничества.

- Медицина: от диагностики заболеваний до разработки новых лекарств.

- Робототехника: от управления роботами-манипуляторами до создания автономных роботов.

Будущее нейронных сетей:

Нейронные сети – это быстро развивающаяся область, и их потенциал огромен.

В будущем мы можем ожидать еще более широкого применения нейронных сетей, а также их интеграции в новые, ранее невозможные области.

Некоторые из возможных применений:

- Персонализированное образование: нейронные сети могут подбирать индивидуальные программы обучения для каждого ученика.

- Виртуальные помощники: нейронные сети будут понимать наши нужды и желания еще лучше, чем сейчас.

- Управление климатом: нейронные сети могут помочь нам разрабатывать более эффективные способы борьбы с изменением климата.

Нейронные сети – это мощный инструмент, который может изменить мир к лучшему.

Важно понимать, что они не являются совершенными и могут иметь свои ограничения.

Однако при ответственном использовании нейронные сети могут стать ключом к решению многих проблем человечества.

Flathub теперь отклоняет приложения и заявки, созданные с помощью искусственного интеллекта

Что новый Google Translate говорит о будущем искусственного интеллекта

Использование нейросетей для подготовки рефератов: алгоритмы и проверка фактов

Google Chrome и 4GB файл weights.bin: что происходит

На поддельном сайте с искусственным интеллектом Claude появилась новая вредоносная программа Beagle для Windows

Скандал вокруг AI Co-Author в VS Code: что произошло и почему разработчики возмутились

Microsoft отказалась от принудительной установки Copilot в Microsoft 365 — что изменилось

Как работает Whisper-бот: распознавание речи, автоматизация и практическое применение

Как AI снижает нагрузку на контакт-центр: от транскрибации до контроля качества 100% звонков