Как работает GAN?

Генеративные состязательные сети (GAN) — это класс моделей машинного обучения, представленный Иэном Гудфеллоу и его коллегами в 2014 году. Они значительно расширили возможности искусственного интеллекта в области генерации реалистичных данных, особенно в области синтеза изображений и видео. В этой статье рассматриваются принципы работы GAN, их архитектура, процесс обучения, общие проблемы и области применения.

Что такое GANs?

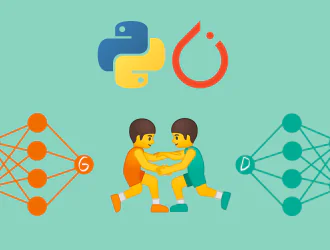

По своей сути GAN состоит из двух нейронных сетей — генератора и дискриминатора, задействованных в сценарии, основанном на теории игр. Генератор предназначен для создания синтетических данных, имитирующих реальные данные, в то время как дискриминатор оценивает, являются ли полученные им данные реальными или сгенерированными. Благодаря этому состязательному процессу обе сети повышают свою производительность, в результате чего создается генератор, который может выдавать очень реалистичные выборки данных.

Архитектура GAN

Вот архитектура GAN:

- Сеть генераторов: Генератор предназначен для получения синтетических выборок данных. Он принимает вектор случайного шума zzz в качестве входных данных и преобразует его в выборку данных G (z) G(z) G (z), которая напоминает реальное распределение данных. Архитектура обычно включает в себя несколько уровней транспонированных сверток (также известных как деконволюции), которые повышают дискретизацию входного вектора шума до желаемой выходной формы.

- Сеть дискриминаторов: Задача дискриминатора — отличать реальные выборки данных от тех, что генерируются генератором. Он берет выборку входных данных (реальных или сгенерированных) и выводит вероятность, указывающую, является ли выборка реальной или поддельной. Дискриминатором обычно является сверточная нейронная сеть (CNN), которая извлекает иерархические признаки из входных данных для составления этой классификации.

- Состязательное обучение: Процесс обучения GAN включает чередование обновления генератора и дискриминатора. Генератор стремится максимизировать вероятность того, что дискриминатор ошибочно классифицирует свои выходные данные как реальные, в то время как дискриминатор стремится минимизировать ошибку при отличии реальных выборок от поддельных.

Принципы работы GaN

Принципы работы GaN следующие:

- Ввод вектора шума: Генератор запускается с вектора шума, обычно выбираемого из равномерного или гауссовского распределения. Этот вектор шума служит представлением скрытого пространства, из которого генератор создает синтетические данные.

- Слои генератора:

- Плотные слои: Начальные слои генератора обычно представляют собой плотные (полностью связанные) слои, которые проецируют входной вектор шума в многомерное пространство.

- Пакетная нормализация: Чтобы стабилизировать обучение и улучшить сходимость, пакетная нормализация часто применяется к выходным данным плотных слоев.

- Транспонированные свертки: Эти слои выполняют повышающую дискретизацию, постепенно увеличивая пространственные размеры данных при одновременном уменьшении глубины, в конечном итоге получая выходные данные с теми же размерами, что и у реальных данных.

- Слои- дискриминаторы:

- Сверточные слои: дискриминатор начинается со сверточных слоев, которые извлекают объекты из входных данных. Эти слои уменьшают пространственные размеры, одновременно увеличивая глубину.

- Leaky ReLU: Функции активации, подобные Leaky ReLU, обычно используются для обеспечения небольшого градиента, когда устройство неактивно, предотвращая гибель нейронов.

- Сигмоидальный вывод: Последний уровень дискриминатора использует функцию активации сигмоида для вывода оценки вероятности от 0 до 1, указывающей на вероятность того, что входные данные реальны.

Заключение

Генеративные состязательные сети представляют собой значительный прогресс в области искусственного интеллекта. Их архитектура, включающая сети генератора и дискриминатора, наряду с состязательным процессом обучения, позволяет создавать высокореалистичные синтетические данные. Несмотря на такие проблемы, как сбой режима и нестабильность тренировок, усовершенствования в вариантах и техниках GAN значительно повысили их надежность и производительность. Благодаря широкому спектру приложений, охватывающих генерацию, перевод и улучшение изображений, GAN продолжают расширять границы возможного в области искусственного интеллекта и машинного обучения. По мере развития исследований GAN, вероятно, будут играть все более важную роль в различных областях, меняя способы генерации данных и взаимодействия с ними.

Часто задаваемые вопросы (FAQs) О том, как работают GAN

Ниже приведены некоторые часто задаваемые вопросы о том, как работают GAN:

1. Что такое генеративная состязательная сеть (GAN)?

Ответ: Генеративная состязательная сеть (GAN) — это модель машинного обучения, состоящая из двух нейронных сетей — генератора и дискриминатора, — которые конкурируют друг с другом за создание и оценку выборок синтетических данных.

2. Как работает генератор в GAN?

Ответ: Генератор принимает вектор случайного шума в качестве входных данных и преобразует его в синтетическую выборку данных, которая напоминает реальные данные. Он использует слои транспонированных сверток для повышения дискретизации вектора шума до желаемой выходной формы.

3. Какова роль дискриминатора в GAN?

Ответ: Дискриминатор оценивает выборки данных, чтобы определить, являются ли они реальными (из обучающего набора данных) или поддельными (сгенерированными генератором). Он использует сверточные слои для извлечения объектов из входных данных и выводит оценку вероятности, указывающую на вероятность того, что данные реальны.

4. Что такое состязательное обучение в GAN?

Ответ: Состязательное обучение — это процесс одновременного обучения сетей генератора и дискриминатора. Генератор стремится выдавать реалистичные данные, чтобы обмануть дискриминатор, в то время как дискриминатор стремится точно отличать реальные данные от поддельных. Этот конкурентный процесс помогает обеим сетям совершенствоваться с течением времени.

5. Как обучаются GAN?

Ответ: GAN обучаются с помощью процесса чередующейся оптимизации. Дискриминатор обучен максимизировать свою способность классифицировать реальные и поддельные данные, а генератор обучен минимизировать способность дискриминатора отличать свои синтетические данные от реальных. Градиентный спуск или его варианты используются для обновления параметров сети.

Редактор: Анастасия