Члены ЮНЕСКО приняли глобальное соглашение по этике и искусственному интеллекту

В мире технологий мы часто с энтузиазмом приветствуем новые разработки, не задумываясь о возможных нежелательных побочных эффектах, но всегда будут существовать сомнительные сущности, ищущие новые способы мошенничества, обмана или чего-то еще хуже — с использованием любых новейших технологий, которые становятся доступными. ИИ обладает огромным потенциалом для развития человечества, но его также легко можно использовать для того, чтобы сдерживать нас или искажать развитие.

Это хорошая новость, что все 193 государства-члена ЮНЕСКО подписали первое в истории глобальное соглашение об этике искусственного интеллекта. ЮНЕСКО предоставляет итоговый документ с полным текстом, описывающим ее цели и задачи, ценности и принципы, предлагаемые области политических действий и графики мониторинга и оценки.

Плюсы искусственного интеллекта — от суперкомпьютеров до Samsung Galaxy

Положительные потенциальные возможности использования ИИ уже хорошо известны специалистам по техническим вопросам. Считается, что системы искусственного интеллекта смогут иметь больше смысла и предложить ответы на очень важные проблемы, с которыми мы сталкиваемся в текущем десятилетии, такие как разработка вакцин, сохранение ограниченных ресурсов и эффективные меры по борьбе с изменением климата.

Например, более близкий к индустрии компьютерных технологий, разработчик графических процессоров Nvidia всегда подчеркивает преимущества ИИ, поскольку она продает специализированное оборудование для обработки ИИ. Помимо научных, медицинских и промышленных приложений, искусственный интеллект также может улучшить игры — с преимуществами как для развития сюжета/NPC, так и для графических улучшений и оптимизаций, таких как DLSS.

Двигаясь вниз по технической лестнице, трудно читать о новых смартфонах, не замечая, что они могут похвастаться технологиями на основе машинного обучения/искусственного интеллекта для настройки пользовательского интерфейса вашего телефона, использования умных помощников и улучшения фотографии.

Негативы ИИ под пристальным вниманием

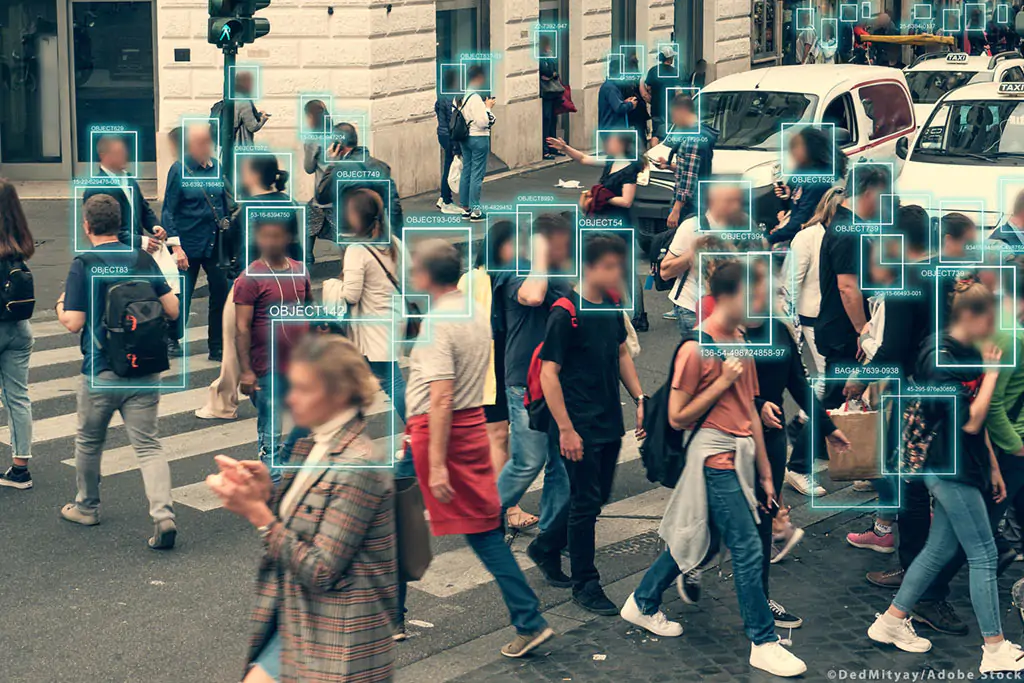

Однако потенциальные недостатки решений искусственного интеллекта уже становятся очевидными. ЮНЕСКО заявляет, что «мы видим усиление гендерных и этнических предубеждений, значительные угрозы частной жизни, достоинству и свободе действий, опасности массового наблюдения и более широкое использование ненадежных технологий искусственного интеллекта в правоохранительных органах и многие другие». Таким образом, он надеется, что новое глобальное соглашение, позволяющее государствам применять этику ИИ по своему собственному усмотрению, но при наличии мониторинга прогресса и практик, должно помочь переломить ситуацию с нежелательными усиками ИИ, распространяющимися в жизни среднего гражданина.

Возможной очевидной слабостью нового соглашения, является способ, которым государства будут «отмечать свое домашнее задание», но установление этих стандартов, вероятно, по-прежнему стоит сделать первый шаг.

Редактор: AndreyEx