OpenAI перенаправляет GPT-4o на модели безопасности при обнаружении вредоносных действий

На выходных некоторые пользователи заметили, что GPT-4o перенаправляет запросы на неизвестную модель. Оказалось, что это функция «безопасности».

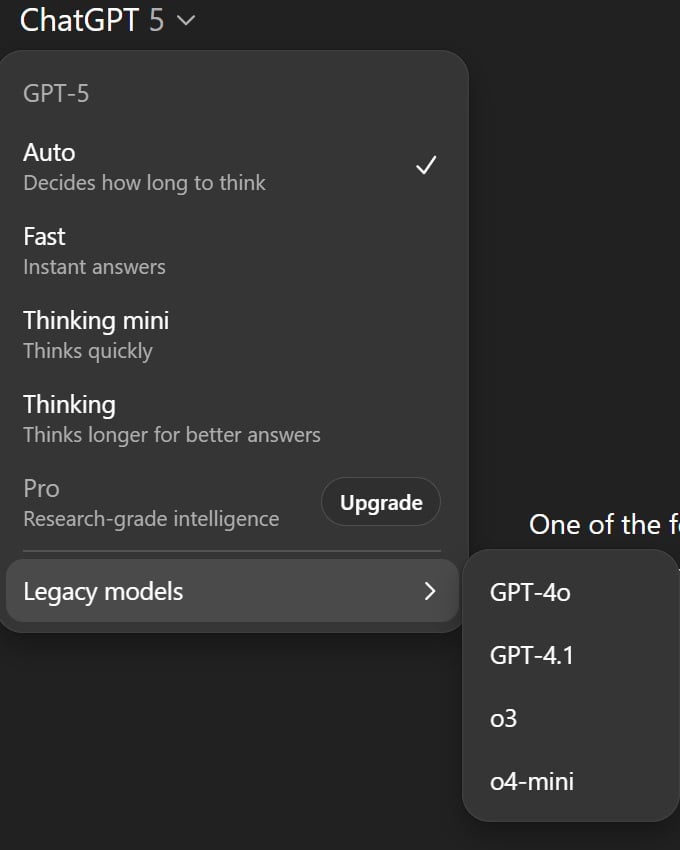

ChatGPT перенаправляет некоторые запросы в другие модели, отличные от ожидаемых. Это может произойти, если вы используете GPT-5 в автоматическом режиме и просите ИИ подумать. Ваши запросы будут перенаправляться в GPT-5.

Это, конечно, хорошо, но пользователей расстроила попытка перенаправить запросы GPT-4 на другие модели, скорее всего, на вариант GPT-5.

Это может произойти, если вы обсуждаете с GPT-4o деликатную или эмоциональную тему и он чувствует, что это может нанести вред. В таких случаях GPT-4o переключится на gpt-5-chat-safety.

Компания OpenAI подтвердила информацию и пояснила, что её намерения не были злыми.

«Маршрутизация происходит для каждого сообщения отдельно; переключение с модели по умолчанию происходит временно. ChatGPT сообщит вам, какая модель активна, если вы спросите», — отметил Ник Терли, вице-президент ChatGPT, в своём посте в X.

«Как мы уже упоминали ранее, когда разговор затрагивает деликатные и эмоциональные темы, система может в середине беседы переключиться на модель рассуждений или GPT-5, предназначенную для более тщательной обработки таких контекстов».

Отключить маршрутизацию невозможно, поскольку это часть реализации OpenAI, обеспечивающая соблюдение мер безопасности.

В OpenAI говорят, что это часть их более масштабных усилий по усилению мер безопасности и изучению практического применения до более широкого внедрения.

Редактор: AndreyEx